روشهای پیشرفته برازش

1. انتخاب کمینهساز مناسب

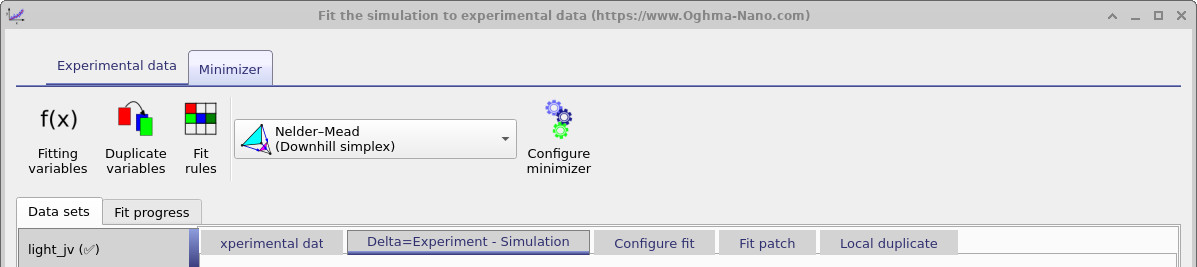

نوار Minimizer جایی است که الگوریتم هدایتکننده فرایند برازش را انتخاب و پیکربندی میکنید. انتخاب کمینهساز مناسب میتواند تفاوت میان یک همگرایی سریع و پایدار و یک برازش کند یا ناپایدار باشد. OghmaNano چندین الگوریتم شناختهشده فراهم میکند که هر کدام نقاط قوت متفاوتی دارند و میتوان آنها را از منوی کشویی Fitting method انتخاب کرد.

بهطور کلی، الگوریتمهای برازش به دو دسته تقسیم میشوند. دسته اول روشهای نزولی یا مبتنی بر گرادیان هستند، که تلاش میکنند «توپی را از سراشیبی پایین بغلتانند» تا به کمینه خطا برسد. بعضی از این روشها به محاسبه صریح گرادیان نیاز دارند، که برای مدلهای پیچیده میتواند پرهزینه و شکننده باشد؛ برخی دیگر بدون مشتق هستند و معمولاً پایدارترند. دسته دوم روشهای آماری هستند، که فقط بهترین برازش را جستوجو نمیکنند بلکه یک توزیع احتمال نیز فراهم میکنند که اعتمادپذیری و یکتایی جواب را نشان میدهد. این روشها از نظر محاسباتی سنگینترند اما میتوانند بینش عمیقتری درباره عدم قطعیت پارامترها ارائه دهند.

| روش | نزولی | گرادیان | آماری | توضیح |

|---|---|---|---|---|

| Nelder-Mead | ✅ | ❌ | ❌ | پایدار، کند، قابلاعتماد |

| Newton | ✅ | ✅ | ❌ | شکننده، گاهی سریع |

| Thermal Annealing | ❌ | ❌ | ✅ | بهطور شگفتآوری خوب |

| MCMC | ❌ | ❌ | ✅ | ? |

| HMC | ❌ | ❌ | ✅ | ? |

Nelder–Mead (Simplex Downhill)

الگوریتم سیمپلکس Nelder–Mead پرکاربردترین روش برازش در OghmaNano است — در واقع، تمام مقالات منتشرشده تا سال 2024 بر آن متکی بودهاند. یک معرفی عمومی از این روش را میتوان اینجا یافت: https://en.wikipedia.org/wiki/Nelder%E2%80%93Mead_method . در عمل، این کمینهساز پایدار است و به گرادیان نیاز ندارد، بنابراین برای مسائل پیچیده مناسب است. گزینههای اصلی پیکربندی آن عبارتاند از:

- Stall steps: اگر خطا پس از تعداد مشخصی گام بهبود نیابد، برازش را متوقف میکند.

- Disable reset at level: از راهاندازی مجدد الگوریتم پس از آنکه خطا به کمتر از آستانه تعریفشده برسد جلوگیری میکند.

- Fit convergence: سطح خطایی را تعریف میکند که در آن برازش همگرا در نظر گرفته میشود و اجرا خاتمه مییابد.

- Start simplex step multiplier: اندازه آشفتگی اولیه پارامتر را تعیین میکند. مقادیر > 1.0 کاوش گسترده فضای پارامتر را تشویق میکنند؛ مقادیر < 1.0 برازش را نزدیک به حدس اولیه نگه میدارند. بهعنوان یک قاعده سرانگشتی، 2.0 «بزرگ» و 0.1 «کوچک» است.

- Enable snapshots during fit: بهصورت پیشفرض snapshots برای کاهش دسترسی به دیسک غیرفعال هستند. روشن کردن این گزینه باعث میشود snapshots در هر گام ذخیره شوند، اما عملکرد را کند میکند.

- Simplex reset steps: مشخص میکند چند گام پیش از بازنشانی سیمپلکس برداشته شوند. بازنشانی میتواند به خروج از کمینههای محلی کمک کند، اما ممکن است جواب را از همگرایی نیز دور کند.

مزیت اصلی Nelder–Mead سادگی و پایداری آن است. از نظر مفهومی، این روش «توپی را از سراشیبی پایین میغلتاند» تا به کمینه سطح خطا برسد، بدون آنکه به محاسبه گرادیان نیاز داشته باشد؛ این ویژگی بهویژه برای مدلهای نویزی یا ناپیوسته ارزشمند است.

💡 نکتههای عملی برای استفاده از Nelder–Mead

- توصیه میکنیم برای بیشتر مسائل برازش، کار را با Nelder–Mead آغاز کنید. فقط زمانی به کمینهسازهای دیگر بروید که همگرایی شکست بخورد یا به بینش آماری نیاز داشته باشید.

- این روش در تمام مقالات OghmaNano منتشرشده تا سال 2024 استفاده شده است، بنابراین یک مبنای اثباتشده و قابلاعتماد برای بازتولیدپذیری است.

- Nelder–Mead برای مسائل با ابعاد بالا (یعنی هنگامی که تعداد زیادی متغیر را همزمان برازش میکنید) میتواند کند باشد.

- همیشه تعداد متغیرهای برازش را به مواردی که واقعاً لازماند محدود کنید — این کار بُعد مسئله را کاهش میدهد و همگرایی را بهبود میبخشد.

- ابتدا One iteration را اجرا کنید تا حساسیت را بررسی کنید، سپس به برازش کامل خودکار متعهد شوید.

Thermal Annealing

Thermal annealing یک روش بهینهسازی تصادفی است که از فرایند فیزیکی سرد کردن یک ماده از دمای بالا به دمای پایین الهام گرفته شده است. در OghmaNano، این الگوریتم فضای پارامتری را که توسط حدود متغیرهایی که تعیین میکنید تعریف شده است کاوش میکند. تنظیم درست آن کرانها ضروری است — کمینهساز بیرون از آنها جستوجو نخواهد کرد.

در عمل، thermal annealing اغلب بهطور شگفتآوری خوب عمل میکند و میتواند در یافتن یک جواب معقول از Nelder–Mead سریعتر باشد. با این حال، برازشهای نهایی گاهی دقت کمتر یا پرداخت کمتری دارند، و ممکن است همچنان به پالایش بیشتر با Nelder–Mead نیاز باشد. Thermal annealing بهویژه برای فرار از کمینههای محلی و انجام کاوش سراسری فضای پارامتر مفید است.

- Dump every n steps: وضعیت فعلی را در فاصلههای مشخصشده روی دیسک ذخیره میکند.

- Cooling constant: کنترل میکند دمای شبیهسازیشده با چه سرعتی کاهش یابد. فرایند سرد شدن از رابطه \( e^{-k(T_{\text{start}}-T_{\text{stop}})} \) پیروی میکند، که در آن \(T_{\text{start}} = 300\,K\) و \(T_{\text{stop}} = 0\,K\).

- Annealing steps: تعداد تکرارهایی که برای سرد کردن سامانه از \(T_{\text{start}}\) به \(T_{\text{stop}}\) استفاده میشوند.

💡 نکتههایی برای استفاده از Thermal Annealing

- بهترین کاربرد آن زمانی است که Nelder–Mead در یک کمینه محلی گیر میکند.

- کرانهای پارامتر را با دقت تنظیم کنید — الگوریتم بیرون از آنها جستوجو نخواهد کرد.

- همگرایی سریعتری نسبت به Nelder–Mead انتظار داشته باشید، اما با نتایج نهایی کمدقتتر.

- در نظر بگیرید پس از آن، Nelder–Mead را برای پالایش جواب بهدستآمده از annealing اجرا کنید.

Newton

روش Newton برای کامل بودن در OghmaNano گنجانده شده است، اما بهندرت برای بیشتر مسائل برازش بهترین انتخاب است. این کمینهساز مبتنی بر گرادیان، در هر گام به محاسبه مشتقات نیاز دارد. اگرچه این ویژگی گاهی میتواند آن را برای بعضی مسائل هموار و خوشرفتار از Nelder–Mead سریعتر کند، اما الگوریتم را شکننده نیز میکند: خطاهای عددی کوچک در ارزیابی مشتق میتوانند باعث واگرایی یا توقف برازش شوند.

در عمل، روش Newton به حدس اولیه و مقیاسبندی متغیرها بسیار حساس است. مگر آنکه مسئله بسیار ساده و خوششرط باشد، همگرایی اغلب ضعیف است. به همین دلایل، معمولاً بهعنوان روش اصلی توصیه نمیشود، اما میتواند بهعنوان ابزار تشخیصی یا برای آزمایش در موارد کنترلشده مفید باشد.

💡 نکتههایی برای استفاده از روش Newton

- فقط از Newton برای مسائل کوچک و همواری استفاده کنید که در آنها حدسهای اولیه خوب در دسترساند.

- اطمینان حاصل کنید بازههای متغیر بهخوبی مقیاسبندی شدهاند — مقیاسبندی ضعیف میتواند باعث واگرایی شود.

- اگر Newton همگرا نشد، به Nelder–Mead یا thermal annealing بازگردید.

- Newton را عمدتاً برای آزمون یا بررسی موارد خاص در نظر بگیرید، نه برای برازش تولیدی.

Markov chain Monte Carlo (MCMC)

Markov chain Monte Carlo (MCMC) یک روش برازش آماری است که فضای پارامتر را بهصورت تصادفی نمونهبرداری میکند، اما به شکلی که با گذر زمان توزیع احتمال درست را میسازد. برخلاف Nelder–Mead یا Newton که یک مجموعه پارامتر «بهترین برازش» منفرد برمیگردانند، MCMC یک توزیع از جوابها تولید میکند که نشان میدهد مقادیر مختلف پارامترها تا چه اندازه محتمل هستند. این ویژگی آن را بهویژه برای کمّیسازی عدم قطعیت و شناسایی همبستگی بین متغیرها قدرتمند میکند. در OghmaNano، پشتیبانی از آن پیادهسازی شده است اما بهصورت پایدار آزموده نشده است.

Hamiltonian Monte Carlo (HMC)

Hamiltonian Monte Carlo (HMC) ایده MCMC را با استفاده از اطلاعات گرادیان برای پیشنهاد پرشهای کارآمدتر در فضای پارامتر گسترش میدهد. بهجای حرکت تصادفی، HMC «حرکت» یک ذره را در چشمانداز likelihood شبیهسازی میکند که توسط گرادیانها هدایت میشود، و این کار میتواند کارایی نمونهبرداری را در مسائل با ابعاد بالا بهطور چشمگیری بهبود دهد. مانند MCMC، HMC نیز بهجای یک جواب منفرد، یک توزیع احتمال روی پارامترهای برازششده تولید میکند. در OghmaNano، پشتیبانی از آن پیادهسازی شده است اما بهصورت پایدار آزموده نشده است.

No-U-Turn Sampler (NUTS)

No-U-Turn Sampler (NUTS) یک گونه تطبیقی از HMC است که بهطور خودکار تصمیم میگیرد چه زمانی یک مسیر در فضای پارامتر متوقف شود تا از محاسبه هدررفته یا بازگشت روی مسیرها جلوگیری شود. این ویژگی NUTS را کاربرپسندتر میکند، زیرا نیاز به تنظیم دستی پارامترهای الگوریتم را کاهش میدهد. NUTS بهطور گسترده یکی از کارآمدترین و پایدارترین روشها برای برآورد پارامتر بیزی در نظر گرفته میشود. در OghmaNano، پشتیبانی از آن پیادهسازی شده است اما بهصورت پایدار آزموده نشده است.

👉 گام بعدی: اکنون به بخش C ادامه دهید تا با روشهای پیشرفتهتر برازش آشنا شوید.