Técnicas avanzadas de ajuste

1. Elegir el minimizador adecuado

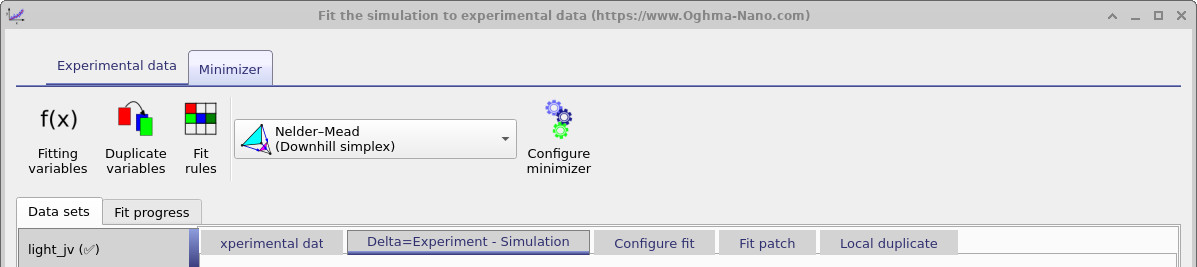

La cinta Minimizer es donde se elige y configura el algoritmo que impulsa el proceso de ajuste. Seleccionar el minimizador adecuado puede marcar la diferencia entre una convergencia rápida y robusta y un ajuste lento o inestable. OghmaNano proporciona varios algoritmos bien establecidos, cada uno con diferentes fortalezas, que pueden seleccionarse en el menú desplegable Fitting method.

En términos generales, los algoritmos de ajuste se dividen en dos categorías. La primera son los métodos descendentes o basados en gradiente, que intentan “hacer rodar una bola cuesta abajo” hasta que alcanza el mínimo error. Algunos de ellos requieren cálculos explícitos de gradientes, lo cual puede ser costoso y frágil para modelos complejos; otros no usan derivadas y suelen ser más robustos. La segunda categoría son los métodos estadísticos, que no solo buscan el mejor ajuste sino que también proporcionan una distribución de probabilidad que indica la confianza y unicidad de la solución. Estos métodos son más exigentes computacionalmente, pero pueden ofrecer una visión más profunda de la incertidumbre de los parámetros.

| Método | Descendente | Gradiente | Estadístico | Comentario |

|---|---|---|---|---|

| Nelder-Mead | ✅ | ❌ | ❌ | Robusto, lento, fiable |

| Newton | ✅ | ✅ | ❌ | Frágil, a veces rápido |

| Thermal Annealing | ❌ | ❌ | ✅ | Sorprendentemente bueno |

| MCMC | ❌ | ❌ | ✅ | ? |

| HMC | ❌ | ❌ | ✅ | ? |

Nelder–Mead (Simplex descendente)

El algoritmo simplex de Nelder–Mead es el método de ajuste más utilizado en OghmaNano — de hecho, todos los artículos publicados hasta 2024 se basaron en él. Puede encontrarse una introducción general al método aquí: https://en.wikipedia.org/wiki/Nelder%E2%80%93Mead_method . En la práctica, este minimizador es robusto y no requiere gradientes, lo que lo hace muy adecuado para problemas complejos. Sus principales opciones de configuración son:

- Stall steps: Detiene el ajuste si el error no mejora después del número de pasos especificado.

- Disable reset at level: Impide que el algoritmo se reinicie una vez que el error ha caído por debajo del umbral definido.

- Fit convergence: Define el nivel de error en el cual el ajuste se considera convergido y la ejecución termina.

- Start simplex step multiplier: Establece el tamaño de la perturbación inicial de los parámetros. Valores > 1.0 favorecen una exploración amplia del espacio de parámetros; valores < 1.0 mantienen el ajuste cerca de la estimación inicial. Como regla práctica, 2.0 es “grande” y 0.1 es “pequeño”.

- Enable snapshots during fit: Por defecto, las instantáneas están desactivadas para reducir el acceso a disco. Activarlo obliga a guardar instantáneas en cada paso, pero ralentiza el rendimiento.

- Simplex reset steps: Especifica cuántos pasos se realizan antes de que el simplex se reinicie. Reiniciar puede ayudar a escapar de mínimos locales, pero también puede alejar la solución de la convergencia.

La principal ventaja de Nelder–Mead es su simplicidad y robustez. Conceptualmente, “hace rodar una bola cuesta abajo” hacia la superficie de error mínimo sin requerir cálculos de gradiente, lo cual es especialmente valioso para modelos ruidosos o discontinuos.

💡 Consejos prácticos para usar Nelder–Mead

- Recomendamos comenzar con Nelder–Mead para la mayoría de los problemas de ajuste. Cambie a otros minimizadores solo si falla la convergencia o si necesita información estadística.

- Este método se utilizó en todos los artículos de OghmaNano publicados hasta 2024, lo que lo convierte en una base probada y fiable para la reproducibilidad.

- Nelder–Mead puede ser lento para problemas de alta dimensionalidad (es decir, al ajustar muchas variables a la vez).

- Minimice siempre el número de variables de ajuste a las estrictamente necesarias — esto reduce la dimensionalidad y mejora la convergencia.

- Ejecute primero One iteration para comprobar la sensibilidad antes de comprometerse con un ajuste automatizado completo.

Recocido térmico

El recocido térmico es un método de optimización estocástico inspirado en el proceso físico de enfriar un material desde alta temperatura a baja temperatura. En OghmaNano, este algoritmo explora el espacio de parámetros definido por los límites de variables que usted especifica. Establecer correctamente esos límites es esencial — el minimizador no buscará más allá de ellos.

En la práctica, el recocido térmico suele funcionar sorprendentemente bien y puede ser más rápido que Nelder–Mead para encontrar una solución razonable. Sin embargo, los ajustes finales a veces son menos precisos o menos “pulidos”, y puede seguir siendo necesario un refinamiento adicional con Nelder–Mead. El recocido térmico es especialmente útil para escapar de mínimos locales y realizar una exploración global del espacio de parámetros.

- Dump every n steps: Guarda el estado actual en disco en el intervalo especificado.

- Cooling constant: Controla la rapidez con la que disminuye la “temperatura” simulada. El enfriamiento sigue \( e^{-k(T_{\text{start}}-T_{\text{stop}})} \), donde \(T_{\text{start}} = 300\,K\) y \(T_{\text{stop}} = 0\,K\).

- Annealing steps: Número de iteraciones utilizadas para enfriar el sistema desde \(T_{\text{start}}\) hasta \(T_{\text{stop}}\).

💡 Consejos para usar Thermal Annealing

- Se utiliza mejor cuando Nelder–Mead se queda atascado en un mínimo local.

- Establezca cuidadosamente los límites de los parámetros — el algoritmo no buscará fuera de ellos.

- Espere una convergencia más rápida que con Nelder–Mead, pero con resultados finales menos precisos.

- Considere ejecutar Nelder–Mead después para refinar la solución obtenida mediante recocido.

Newton

El método de Newton está incluido en OghmaNano por completitud, pero rara vez es la mejor opción para la mayoría de los problemas de ajuste. Como minimizador basado en gradiente, requiere que se calculen derivadas en cada paso. Aunque esto puede hacerlo ocasionalmente más rápido que Nelder–Mead para ciertos problemas suaves y bien comportados, también hace que el algoritmo sea frágil: pequeños errores numéricos en la evaluación de derivadas pueden hacer que el ajuste diverja o se estanque.

En la práctica, el método de Newton es muy sensible a la estimación inicial y al escalado de las variables. A menos que el problema sea muy simple y esté bien condicionado, la convergencia suele ser pobre. Por estas razones, en general no se recomienda como método principal, aunque puede ser útil como herramienta de diagnóstico o para experimentación en casos controlados.

💡 Consejos para usar el método de Newton

- Use Newton solo en problemas pequeños y suaves donde se disponga de buenas estimaciones iniciales.

- Asegúrese de que los intervalos de las variables estén bien escalados — un mal escalado puede causar divergencia.

- Si Newton no converge, vuelva a Nelder–Mead o al recocido térmico.

- Considere Newton principalmente para pruebas o para explorar casos específicos, no para ajuste de producción.

Monte Carlo con cadenas de Markov (MCMC)

El método Monte Carlo con cadenas de Markov (MCMC) es un método de ajuste estadístico que muestrea el espacio de parámetros aleatoriamente, pero de una manera que construye la distribución de probabilidad correcta con el tiempo. A diferencia de Nelder–Mead o Newton, que devuelven un único conjunto de parámetros de “mejor ajuste”, MCMC produce una distribución de soluciones que muestra cuán probables son diferentes valores de parámetros. Esto lo hace especialmente potente para cuantificar la incertidumbre e identificar correlaciones entre variables. En OghmaNano, el soporte está implementado pero no ha sido probado de forma robusta.

Monte Carlo hamiltoniano (HMC)

El Monte Carlo hamiltoniano (HMC) amplía la idea de MCMC utilizando información de gradiente para proponer saltos más eficientes a través del espacio de parámetros. En lugar de moverse aleatoriamente, HMC simula el “movimiento” de una partícula a través del paisaje de verosimilitud, guiada por gradientes, lo que puede mejorar drásticamente la eficiencia del muestreo en problemas de alta dimensionalidad. Al igual que MCMC, HMC genera una distribución de probabilidad sobre los parámetros ajustados en lugar de una única solución. En OghmaNano, el soporte está implementado pero no ha sido probado de forma robusta.

Muestreador No-U-Turn (NUTS)

El muestreador No-U-Turn (NUTS) es una variante adaptativa de HMC que decide automáticamente cuándo detener una trayectoria a través del espacio de parámetros para evitar computación desperdiciada o volver sobre el mismo camino. Esto hace que NUTS sea más fácil de usar, ya que reduce la necesidad de ajustar manualmente los parámetros del algoritmo. NUTS se considera ampliamente uno de los métodos más eficientes y robustos para la estimación bayesiana de parámetros. En OghmaNano, el soporte está implementado pero no ha sido probado de forma robusta.

👉 Siguiente paso: Ahora continúe con Parte C para métodos de ajuste más avanzados.